الذكاء الاصطناعي (منظمة العفو الدولية) هي قدرة الكمبيوتر أو الروبوت الذي يتم التحكم فيه بواسطة الكمبيوتر على أداء المهام التي ترتبط عادة بالعمليات الفكرية المميزة للبشر.[1]

مع ظهور الذكاء الاصطناعي, يخشى الكثيرون أن تتولى أجهزة الكمبيوتر عمل العمال البشريين, خاصة في المجالات التي يمكن للكمبيوتر أن يعمل فيها بشكل أفضل. مثال على هذا المجال هو العمل القانوني, حيث أثبتت إحدى الدراسات أن قدرات الذكاء الاصطناعي تفوق بكثير قدرات المحامين البشريين في جوانب معينة. على سبيل المثال, الذكاء الاصطناعي قادر على صياغة خمس اتفاقيات عدم الإفشاء في 26 ثانية بدقة 94.55%, بينما احتاج المحامون إلى ساعة على الأقل وحققوا دقة متوسطة تبلغ 84.84%.[2]

الذكاء الاصطناعي في وضعه الحالي, ومع ذلك, بعيد عن الكمال. وقد ظهر ذلك عندما تم تغريم محاميين أمريكيين بالدولار الأمريكي 5,000 لأنهم اعتمدوا على الذكاء الاصطناعي للتوصل إلى سوابق قضائية لأحد مذكراتهم. الحالات التي أشار إليها ChatGPT غير موجودة, على الرغم من أن ChatGPT أكد للمحامين أن القضايا حقيقية.[3] يوضح هذا المثال بوضوح المخاطر الكامنة في استخدام الذكاء الاصطناعي في الدعاوى القضائية والتحكيم الدولي.

تنظيم الذكاء الاصطناعي في التحكيم الدولي

حاليا, كما هو الحال في كل المجالات الأخرى تقريبًا, استخدام الذكاء الاصطناعي في إجراءات التحكيم غير منظم في الغالب. وبالتالي, يجب على محامي التحكيم التعامل مع هذه التكنولوجيا الجديدة بحذر.

الرائد في تنظيم الذكاء الاصطناعي في العمل القانوني هو التحكيم وادي السيليكون & مركز الوساطة (SVAMC), منتدى متخصص في تسوية المنازعات المتعلقة بالتكنولوجيا. في أغسطس من 2023, نشرت SVAMC تقريرها مشروع المبادئ التوجيهية بشأن استخدام الذكاء الاصطناعي في التحكيم الدولي (المبادئ التوجيهية"). لم يتم اعتماد هذه الإرشادات بعد، ولكنها تم إتاحتها للجمهور فقط في شكل مسودة حتى يتمكن الممارسون من تقديم الملاحظات والتعليقات قبل نشر النسخة النهائية.

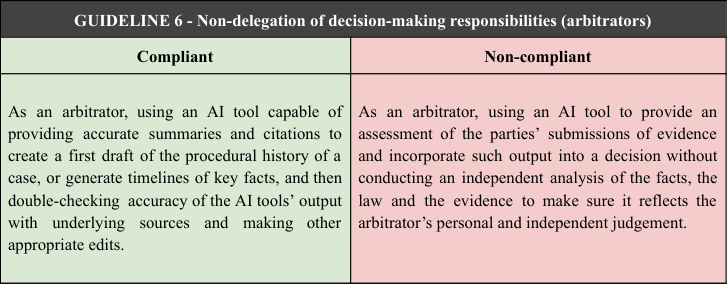

تحتوي المبادئ التوجيهية على قواعد موجهة إلى الأطراف, ممثليهم القانونيين والمحكمين. كما أنه يفرق بين الاستخدام المتوافق وغير المتوافق للذكاء الاصطناعي, الأخير هو في الأساس استخدام الذكاء الاصطناعي دون مدخلات بشرية وتقييم النتائج لاختيار المحكمين وصياغة الطلبات أو الجوائز. على سبيل المثال, لا يزال يتعين على المحكمين إجراء تقييم مستقل للحقائق, القانون والأدلة:

أدوات الذكاء الاصطناعي المستخدمة حاليًا من قبل محامي التحكيم الدولي

يمكن بالفعل استخدام الذكاء الاصطناعي في التحكيم الدولي في عدة جوانب مختلفة من العمل القانوني.

لإجراء البحوث القانونية, يمكن لمحامي التحكيم الدولي استخدام الذكاء الاصطناعي لاستكمال عملهم وتسريع أجزاء معينة من العملية. منظمة العفو الدولية, ومع ذلك, لا يسمح حاليًا بالبحث الآلي بالكامل. منصات مثل Jus-AI (بواسطة جوس موندي), كسيس + منظمة العفو الدولية (بواسطة LexisNexis) وويستلو إيدج (بواسطة طومسون رويترز) لقد تم بالفعل تقديمها للجمهور. عصير-AI يستخدم ChatGPT كمحرك له ويوفر منصة مركزية حيث يجيب الذكاء الاصطناعي على الأسئلة بناءً على قاعدة بيانات Jus Mundi. كسيس + منظمة العفو الدولية يمكن أن تفعل الشيء نفسه, ولكنه قادر أيضًا على صياغة الحجج, بنود العقد واتصالات العملاء, وكذلك تحليل وتلخيص محتوى الوثائق. ويستلو إيدج هي نسخة معززة من أداة بحث Westlaw المعروفة, والذي يوفر أيضًا تحليلات التقاضي بمعلومات مفصلة عن القضاة, المحاكم, الأضرار, المحامين وأنواع القضايا. كما أنه يتميز أيضًا بما يسمى بتقييم "مخاطر تجاوز KeyCite"., الذي يحذر مستخدمه عندما "تم تقويض نقطة القانون ضمنيًا بناءً على اعتمادها على قرار مسبق ملغى أو غير صالح."[4]

لإحدى الخطوات الأولى للإجراءات, اختيار المحكمين, يمكن للمحامين أيضًا استخدام أدوات مثل Arbitrator Intelligence, والذي يسمح للممارسين بمشاركة المعلومات والتعليقات حول المحكمين دون انتهاك سرية الإجراءات أو قرارات التحكيم. لتحقيق هذا, لا تقوم ذكاء التحكيم بجمع البيانات التي من شأنها تحديد القضية أو الأطراف. في حين أن, يطلب معلومات تسهل تحليل عملية صنع القرار ونتائج القضية الشاملة لبعض المحكمين.

عادةً ما يعمل محامو التحكيم الدولي مع المستندات بمجموعة متنوعة من اللغات المختلفة. ديب إل هي أداة مدعومة بالذكاء الاصطناعي تستخدم شبكات عصبية اصطناعية يمكنها تسريع الترجمة الأولية للمستندات المكتوبة باللغة الأجنبية بشكل كبير. بينما أداة الترجمة من جوجل (جوجل المترجم) تتطور, تعتبر الأدوات مثل DeepL أكثر موثوقية حاليًا. ديب إل, في وقت نشر المذكرة الحالية, يمكن أن تترجم من وإلى 27 لغات مختلفة بدقة عالية مع التعلم أيضًا من أخطائه السابقة ومدخلات المستخدم.

كما قام بعض المحامين بتطبيق الذكاء الاصطناعي في التحكيم الدولي لأغراض الصياغة. وبصرف النظر عن الأدوات المذكورة أعلاه, يعتمد المحامون أحيانًا على ChatGPT لصياغة أجزاء معينة من التقديمات أو شروط العقد. يجب التعامل مع هذا بحذر, ومع ذلك. الذكاء الاصطناعي, في وضعها الحالي, يشتهر بعدم قدرته على التمييز بين المعلومات الصحيحة وغير الصحيحة. كما أنه يخترع المعلومات (المعروفة باسم هلاوس الذكاء الاصطناعي) لسد الفجوات في معرفتها.[5] وهذا هو السبب الرئيسي الذي يجعل الاعتماد على الذكاء الاصطناعي لصياغة الطلبات في قضايا التحكيم الدولي دون تدخل بشري مناسب بمثابة استخدام غير متوافق للذكاء الاصطناعي بموجب إرشادات SVAMC ويجب تجنبه.

قضايا الخصوصية مع استخدام الذكاء الاصطناعي في التحكيم الدولي

إحدى القضايا الحاسمة المتعلقة باستخدام الذكاء الاصطناعي في العمل القانوني هي مراعاة خصوصية البيانات. بينما توفر معظم الأدوات المذكورة أعلاه مستوى مرتفعًا من أمان البيانات لمستخدميها المشتركين, لا يزال تحميل المعلومات السرية على هذه المنصات يمثل مشكلة. من المهم الأخذ في الاعتبار أن نماذج الذكاء الاصطناعي هذه "تتعلم" باستمرار من البيانات الجديدة التي تتم مشاركتها معها ويمكنها أيضًا تذكر المعلومات التي تمت معالجتها مسبقًا وإعادة استخدامها. مشاركة المستندات القانونية غير المنقحة, وبالتالي, يمكن أن يؤدي إلى مشكلات خطيرة وحتى انتهاكات للوائح مثل اللائحة العامة لحماية البيانات.[6]

استنتاج

هناك مخاطر كبيرة مرتبطة باستخدام الذكاء الاصطناعي في التحكيم الدولي والمهام القانونية الأخرى في وضعه الحالي. يمكن أن تحدث أخطاء جسيمة في غياب الإشراف البشري الكافي والمدخلات. كنتيجة ل, مطلوب الحذر الشديد. على الجانب الإيجابي, وهذا يعني أيضًا أن المحامين لا يستطيعون ذلك (لفترة على الاقل) ليحل محلها الذكاء الاصطناعي. بدلا, يمكن للذكاء الاصطناعي أن يزود المهنيين القانونيين بأدوات جديدة لجعل جوانب معينة من عملهم أكثر كفاءة.

[1] بريتانيكا, الذكاء الاصطناعي, نوفمبر 2023, https://www.britannica.com/technology/artificial-intelligence (آخر الوصول إليها 24 شهر نوفمبر 2023).

[2] Lrz.legal, الذكاء الاصطناعي مقابل. الإنسان في مهنة المحاماة – الذكاء الاصطناعي مقابل الذكاء الاصطناعي. مهنة المحاماة, قد 2018, https://lrz.legal/de/lrz/artificial-intelligence-vs-human-in-the-legal-profession (آخر الوصول إليها 24 شهر نوفمبر 2023).

[3] الحارس, تم تغريم محاميين أمريكيين لتقديمهما استشهادات مزيفة للمحكمة من ChatGPT, يونيو 2023, https://www.theguardian.com/technology/2023/jun/23/two-us-lawyers-fined-submitting-fake-court-citations-chatgpt (آخر الوصول إليها 24 شهر نوفمبر 2023).

[4] طومسون رويترز, تم تغريم محاميين أمريكيين لتقديمهما استشهادات مزيفة للمحكمة من ChatGPT, https://legal.thomsonreuters.com/en/products/westlaw-edge/features (آخر الوصول إليها 24 شهر نوفمبر 2023).

[5] سكريبر, هل ChatGPT جدير بالثقة? | تم اختبار الدقة, شهر نوفمبر 2023, https://www.scribbr.com/ai-tools/is-chatgpt-trustworthy/ (آخر الوصول إليها 24 شهر نوفمبر 2023).

[6] Legalfly.ai, الذكاء الاصطناعي القانوني: مخاطر خصوصية البيانات غير المرئية, أغسطس 2023, https://www.legalfly.ai/blog/data-privacy (آخر الوصول إليها 24 شهر نوفمبر 2023).