Intelligenza artificiale (AI) è la capacità di un computer o di un robot controllato da computer di eseguire compiti comunemente associati ai processi intellettuali caratteristici degli esseri umani.[1]

Con l'avvento dell'AI, molti temono che i computer sostituiranno il lavoro dei lavoratori umani, soprattutto nei campi in cui un computer può effettivamente funzionare meglio. Un esempio di tale campo è il lavoro legale, dove uno studio ha dimostrato che le capacità dell’intelligenza artificiale superano di gran lunga quelle degli avvocati umani per certi aspetti. Per esempio, un'IA è in grado di redigere cinque NDA in 26 secondi con una precisione di 94.55%, mentre gli avvocati impiegavano almeno un'ora e raggiungevano una precisione media di 84.84%.[2]

L'intelligenza artificiale nel suo stato attuale, però, è tutt'altro che perfetto. Ciò è stato dimostrato quando due avvocati statunitensi sono stati multati in dollari 5,000 perché si affidavano all’intelligenza artificiale per elaborare la giurisprudenza per una delle loro osservazioni. I casi a cui fa riferimento ChatGPT non esistevano, sebbene ChatGPT abbia assicurato agli avvocati che i casi erano reali.[3] Questo esempio mostra chiaramente i pericoli sottostanti all’uso dell’intelligenza artificiale nei contenziosi e negli arbitrati internazionali.

La regolamentazione dell'IA nell'arbitrato internazionale

Attualmente, come in quasi ogni altro campo, l’uso dell’intelligenza artificiale nei procedimenti arbitrali è per lo più non regolamentato. Perciò, gli avvocati arbitrali devono avvicinarsi a questa nuova tecnologia con cautela.

Il pioniere nella regolamentazione dell’IA nel lavoro legale è il Arbitrato della Silicon Valley & Centro di mediazione (SVAMC), un forum specializzato nella risoluzione delle controversie legate alla tecnologia. Nell'agosto del 2023, SVAMC ha pubblicato il suo Progetto di linee guida sull'uso dell'intelligenza artificiale nell'arbitrato internazionale (le “Linee guida”). Queste linee guida non sono state ancora adottate ma sono state rese pubbliche solo in forma di bozza in modo che gli operatori possano fornire feedback e commenti prima della pubblicazione della versione finale.

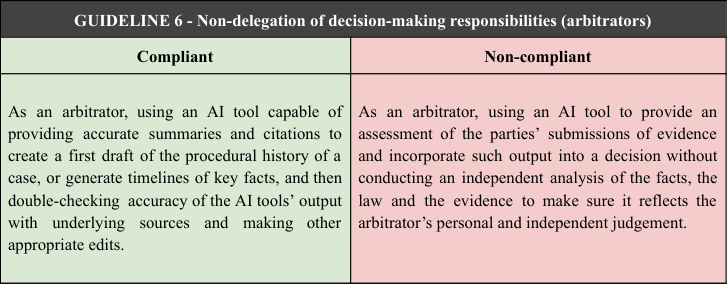

Le Linee Guida contengono norme rivolte alle parti, i loro rappresentanti legali e arbitri. Distingue inoltre tra utilizzo conforme e non conforme dell’IA, quest'ultimo consiste essenzialmente nell'uso dell'intelligenza artificiale senza input umano e una valutazione dei risultati per selezionare gli arbitri e redigere conclusioni o lodi. Per esempio, gli arbitri devono comunque condurre una valutazione indipendente dei fatti, la legge e le prove:

Strumenti di intelligenza artificiale attualmente utilizzati dagli avvocati arbitrali internazionali

L’intelligenza artificiale può già essere utilizzata nell’arbitrato internazionale in diversi aspetti del lavoro legale.

Per condurre ricerche giuridiche, gli avvocati arbitrali internazionali possono utilizzare l'intelligenza artificiale per integrare il proprio lavoro e accelerare alcune parti del processo. AI, però, attualmente non consente ricerche completamente automatizzate. Piattaforme come Jus-AI (di Jus Mundi), Lexis+AI (di LexisNexis) e Westlaw Bordo (di Thomson Reuters) sono già stati presentati al pubblico. Juice-AI utilizza ChatGPT come motore e fornisce una piattaforma centralizzata dove l'IA risponde alle domande basandosi sul database Jus Mundi. Lexis+AI può fare lo stesso, ma è anche in grado di elaborare argomentazioni, clausole contrattuali e comunicazioni al cliente, nonché analizzare e riassumere il contenuto dei documenti. Bordo di Westlaw è una versione potenziata del noto strumento di ricerca Westlaw, che fornisce anche analisi del contenzioso con informazioni dettagliate sui giudici, tribunali, danni, avvocati e tipi di casi. Presenta inoltre la cosiddetta valutazione “KeyCite Overruling Risk”., che avvisa l'utente quando un "punto di diritto è stato implicitamente minato sulla base del suo affidamento su una decisione precedente annullata o altrimenti invalida."[4]

Per uno dei primi passi del procedimento, la scelta degli arbitri, gli avvocati possono anche utilizzare strumenti come Arbitrator Intelligence, che consente ai professionisti di condividere informazioni e feedback sugli arbitri senza violare la riservatezza dei procedimenti o dei lodi. Per realizzare questo, Arbitrator Intelligence non raccoglie dati che possano identificare il caso o le parti. Anziché, richiede informazioni che facilitino l'analisi del processo decisionale e degli esiti complessivi dei casi di alcuni arbitri.

Gli avvocati che si occupano di arbitrato internazionale lavorano tipicamente con documenti in una varietà di lingue diverse. DeepL è uno strumento basato sull'intelligenza artificiale che utilizza reti neurali artificiali che possono accelerare notevolmente la traduzione iniziale di documenti in lingua straniera. Mentre lo strumento di traduzione di Google (Google Traduttore) sta migliorando, strumenti come DeepL sono attualmente più affidabili. DeepL, al momento della pubblicazione della presente nota, può tradurre da e verso 27 lingue diverse con elevata precisione, imparando anche dagli errori precedenti e dagli input dell'utente.

Alcuni avvocati hanno applicato l’intelligenza artificiale anche nell’arbitrato internazionale a fini di redazione. A parte gli strumenti sopra elencati, gli avvocati a volte si affidano a ChatGPT per redigere alcune parti delle comunicazioni o delle clausole contrattuali. Questo deve essere affrontato con cautela, però. Intelligenza artificiale, nel suo stato attuale, è famoso per non essere in grado di distinguere tra informazioni corrette e errate. Inventa anche informazioni (note come allucinazioni dell'intelligenza artificiale) colmare le lacune della sua conoscenza.[5] Questo è uno dei motivi principali per cui fare affidamento sull’intelligenza artificiale per redigere proposte in casi arbitrali internazionali senza un adeguato intervento umano equivarrà a un uso non conforme dell’intelligenza artificiale ai sensi delle linee guida SVAMC e dovrebbe essere evitato.

Problemi di privacy con l'uso dell'intelligenza artificiale nell'arbitrato internazionale

Una delle questioni cruciali nell’utilizzo dell’intelligenza artificiale per il lavoro legale è la considerazione della privacy dei dati. Mentre la maggior parte degli strumenti di cui sopra fornisce un livello elevato di sicurezza dei dati agli utenti abbonati, caricare informazioni riservate su queste piattaforme può ancora essere problematico. È importante considerare che questi modelli di IA “imparano” continuamente dai nuovi dati condivisi con loro e possono anche ricordare e riutilizzare informazioni precedentemente elaborate. Condivisione di documenti legali non oscurati, perciò, può portare a gravi problemi e persino a violazioni di normative come il GDPR.[6]

Conclusione

Esistono rischi significativi associati all’utilizzo dell’IA negli arbitrati internazionali e in altri compiti legali nelle sue condizioni attuali. Possono verificarsi gravi errori in assenza di sufficiente supervisione e input umano. Di conseguenza, è necessaria la massima cautela. Il lato positivo, questo significa anche che gli avvocati non possono (almeno per un po) essere sostituita dall’Intelligenza Artificiale. Piuttosto, L’intelligenza artificiale può fornire ai professionisti legali nuovi strumenti per rendere più efficienti alcuni aspetti del loro lavoro.

[1] Britannica, intelligenza artificiale, novembre 2023, https://www.britannica.com/technology/artificial-intelligence (ultimo accesso 24 novembre 2023).

[2] Lrz.legal, Intelligenza Artificiale vs. L'essere umano nella professione legale – IA vs. Professione legale, Maggio 2018, https://lrz.legal/de/lrz/artificial-intelligence-vs-human-in-the-legal-profession (ultimo accesso 24 novembre 2023).

[3] Il guardiano, Due avvocati statunitensi multati per aver presentato false citazioni in tribunale da ChatGPT, giugno 2023, https://www.theguardian.com/technology/2023/jun/23/two-us-lawyers-fined-subforming-fake-court-citations-chatgpt (ultimo accesso 24 novembre 2023).

[4] Thomson Reuters, Due avvocati statunitensi multati per aver presentato false citazioni in tribunale da ChatGPT, https://legal.thomsonreuters.com/en/products/westlaw-edge/features (ultimo accesso 24 novembre 2023).

[5] Scribbr, ChatGPT è affidabile? | Precisione testata, novembre 2023, https://www.scribbr.com/ai-tools/is-chatgpt-trustworthy/ (ultimo accesso 24 novembre 2023).

[6] Legalfly.ai, IA legale: I rischi invisibili per la privacy dei dati, agosto 2023, https://www.legalfly.ai/blog/data-privacy (ultimo accesso 24 novembre 2023).