Sztuczna inteligencja (sztuczna inteligencja) to zdolność komputera lub robota sterowanego komputerowo do wykonywania zadań powszechnie związanych z procesami intelektualnymi charakterystycznymi dla człowieka.[1]

Wraz z pojawieniem się AI, wielu obawia się, że komputery przejmą pracę ludzi, zwłaszcza w dziedzinach, w których komputer może faktycznie działać lepiej. Przykładem takiej dziedziny jest legalna praca, gdzie badanie wykazało, że możliwości sztucznej inteligencji znacznie przewyższają możliwości prawników-ludzi pod pewnymi względami. Na przykład, sztuczna inteligencja jest w stanie sporządzić pięć umów NDA 26 sekund z dokładnością do 94.55%, podczas gdy prawnicy potrzebowali co najmniej godziny i osiągnęli średnią dokładność 84.84%.[2]

AI w obecnym stanie, jednak, jest daleki od doskonałości. Zostało to zaprezentowane, gdy dwóch amerykańskich prawników zostało ukaranych grzywną w dolarach amerykańskich 5,000 ponieważ polegali na sztucznej inteligencji przy opracowywaniu orzecznictwa w odniesieniu do jednego ze swoich wniosków. Przypadki, o których wspomniał ChatGPT, nie istniały, chociaż ChatGPT zapewnił prawników, że sprawy są prawdziwe.[3] Przykład ten wyraźnie pokazuje podstawowe zagrożenia związane z wykorzystaniem sztucznej inteligencji w sporach sądowych i arbitrażu międzynarodowym.

Regulacja AI w arbitrażu międzynarodowym

W tej chwili, jak w niemal każdej innej dziedzinie, wykorzystanie sztucznej inteligencji w postępowaniach arbitrażowych jest w większości nieuregulowane. W związku z tym, prawnicy zajmujący się arbitrażem muszą podchodzić do tej nowej technologii z ostrożnością.

Pionierem w zakresie regulacji sztucznej inteligencji w legalnej pracy jest: Arbitraż w Dolinie Krzemowej & Centrum Mediacji (SVAMC), forum specjalizujące się w rozwiązywaniu sporów technologicznych. W sierpniu 2023, SVAMC opublikowało swoje Projekt Wytycznych w sprawie wykorzystania sztucznej inteligencji w arbitrażu międzynarodowym („Wytyczne”). Wytyczne te nie zostały jeszcze przyjęte, ale zostały udostępnione publicznie jedynie w formie roboczej, aby praktycy mogli przekazać uwagi i uwagi przed opublikowaniem ostatecznej wersji.

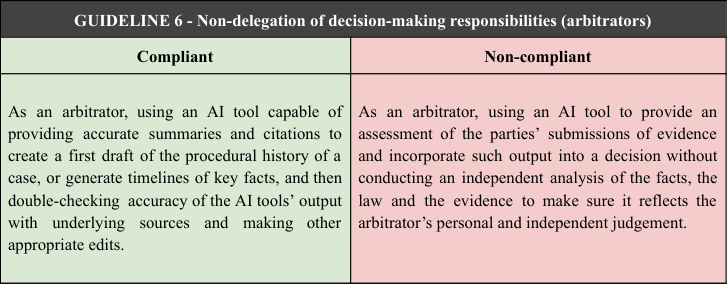

Wytyczne zawierają zasady skierowane do stron, ich przedstawiciele prawni i arbitrzy. Rozróżnia także zgodne i niezgodne wykorzystanie sztucznej inteligencji, ta ostatnia polega zasadniczo na wykorzystaniu sztucznej inteligencji bez udziału człowieka i ocenie wyników w celu wybrania arbitrów oraz projektów wniosków lub orzeczeń. Na przykład, arbitrzy muszą w dalszym ciągu przeprowadzić niezależną ocenę faktów, prawo i dowody:

Narzędzia AI obecnie używane przez prawników zajmujących się międzynarodowym arbitrażem

Sztuczną inteligencję można już stosować w arbitrażu międzynarodowym w kilku różnych aspektach pracy prawniczej.

Aby przeprowadzić badania prawne, prawnicy zajmujący się arbitrażem międzynarodowym mogą wykorzystywać sztuczną inteligencję do uzupełniania własnej pracy i przyspieszania niektórych części procesu. sztuczna inteligencja, jednak, obecnie nie pozwala na w pełni zautomatyzowane badania. Platformy takie jak Jus-AI (przez Jus Mundi), Lexis+ sztuczna inteligencja (autor: LexisNexis) i Westlaw Edge (przez Thomsona Reutersa) zostały już podane do wiadomości publicznej. Sok-AI wykorzystuje ChatGPT jako swój silnik i zapewnia scentralizowaną platformę, na której sztuczna inteligencja odpowiada na pytania w oparciu o bazę danych Jus Mundi. Lexis+ sztuczna inteligencja może zrobić to samo, ale potrafi też formułować argumenty, klauzule umowne i komunikacja z klientem, a także analizować i podsumowywać treść dokumentów. Westlaw Edge to udoskonalona wersja dobrze znanego narzędzia badawczego Westlaw, która zapewnia również analizę postępowań sądowych ze szczegółowymi informacjami na temat sędziów, sądy, odszkodowanie, prawnicy i rodzaje spraw. Zawiera także tak zwaną ocenę „ryzyka unieważnienia KeyCite”., który ostrzega użytkownika, gdy „punkt prawny został w sposób dorozumiany podważony w oparciu o oparcie się na wcześniejszej decyzji, która została uchylona lub z innego powodu nieważna.”[4]

Na jeden z pierwszych etapów postępowania, wybór arbitrów, prawnicy mogą również korzystać z narzędzi takich jak Arbitrator Intelligence, co pozwala praktykom dzielić się informacjami i opiniami na temat arbitrów bez naruszania poufności postępowań i wyroków. Osiągnąć to, Arbitrator Intelligence nie gromadzi danych identyfikujących sprawę lub strony. Zamiast, prosi o informacje ułatwiające analizę procesu decyzyjnego i ogólnych wyników spraw niektórych arbitrów.

Prawnicy zajmujący się arbitrażem międzynarodowym zazwyczaj pracują z dokumentami w różnych językach. Głęboko L to narzędzie oparte na sztucznej inteligencji, wykorzystujące sztuczne sieci neuronowe, które może znacznie przyspieszyć wstępne tłumaczenie dokumentów obcojęzycznych. Chociaż narzędzie do tłumaczenia Google (tłumacz Google) polepsza się, narzędzia takie jak DeepL są obecnie bardziej niezawodne. Głęboko L, w momencie publikacji bieżącej noty, może tłumaczyć do i z 27 różnych językach z dużą dokładnością, jednocześnie ucząc się na wcześniejszych błędach i danych wejściowych użytkownika.

Niektórzy prawnicy zastosowali również sztuczną inteligencję w arbitrażu międzynarodowym do celów redakcyjnych. Oprócz narzędzi wymienionych powyżej, prawnicy czasami polegają na ChatGPT przy sporządzaniu niektórych części oświadczeń lub klauzul umownych. Należy do tego podchodzić ostrożnie, jednak. Sztuczna inteligencja, w obecnym stanie, słynie z tego, że nie potrafi odróżnić informacji prawidłowych od błędnych. Wymyśla także informację (znane jako halucynacje AI) uzupełnić luki w swojej wiedzy.[5] Jest to kluczowy powód, dla którego poleganie na sztucznej inteligencji przy sporządzaniu wniosków w sprawach dotyczących arbitrażu międzynarodowego bez odpowiedniej interwencji człowieka będzie równoznaczne z wykorzystaniem sztucznej inteligencji niezgodnie z wytycznymi SVAMC i należy go unikać.

Problemy prywatności związane z wykorzystaniem sztucznej inteligencji w arbitrażu międzynarodowym

Jedną z kluczowych kwestii związanych z wykorzystaniem sztucznej inteligencji w pracy prawniczej jest uwzględnienie prywatności danych. Chociaż większość powyższych narzędzi zapewnia podwyższony poziom bezpieczeństwa danych subskrybowanym użytkownikom, przesyłanie poufnych informacji na te platformy może w dalszym ciągu być problematyczne. Należy wziąć pod uwagę, że te modele sztucznej inteligencji stale „uczą się” na podstawie nowych udostępnionych im danych, a także mogą zapamiętywać i ponownie wykorzystywać wcześniej przetworzone informacje. Udostępnianie niezredagowanych dokumentów prawnych, w związku z tym, może prowadzić do poważnych problemów, a nawet naruszeń przepisów takich jak RODO.[6]

Wniosek

W jej obecnym stanie istnieją znaczne zagrożenia związane z wykorzystaniem sztucznej inteligencji w arbitrażu międzynarodowym i innych zadaniach prawnych. W przypadku braku wystarczającego nadzoru i wkładu człowieka mogą wystąpić poważne błędy. W rezultacie, wymagana jest szczególna ostrożność. Z dobrej strony, oznacza to również, że prawnicy nie mogą (Przynajmniej przez chwilę) zostać zastąpiona przez sztuczną inteligencję. Raczej, Sztuczna inteligencja może zapewnić prawnikom nowe narzędzia, dzięki którym niektóre aspekty ich pracy będą bardziej wydajne.

[1] Brytyjska, sztuczna inteligencja, Listopad 2023, https://www.britannica.com/technology/artificial-intelligence (ostatni dostęp 24 listopad 2023).

[2] Lrz.legal, Sztuczna inteligencja vs. Człowiek w zawodzie prawniczym – sztuczna inteligencja vs. Legalna Profesja, Może 2018, https://lrz.legal/de/lrz/sztuczna-inteligencja-vs-człowiek-w-zawodzie-prawniczym (ostatni dostęp 24 listopad 2023).

[3] Opiekun, Dwóch amerykańskich prawników ukaranych grzywną za składanie fałszywych cytatów sądowych z ChatGPT, czerwiec 2023, https://www.theguardian.com/technology/2023/jun/23/two-us-lawyers-fined-submitting-fake-court-citations-chatgpt (ostatni dostęp 24 listopad 2023).

[4] Thomsona Reutera, Dwóch amerykańskich prawników ukaranych grzywną za składanie fałszywych cytatów sądowych z ChatGPT, https://legal.thomsonreuters.com/en/products/westlaw-edge/features (ostatni dostęp 24 listopad 2023).

[5] Skrybr, Czy ChatGPT jest godny zaufania? | Testowana dokładność, listopad 2023, https://www.scribbr.com/ai-tools/is-chatgpt-trustworthy/ (ostatni dostęp 24 listopad 2023).

[6] Legalfly.ai, Legalna sztuczna inteligencja: Niewidoczne zagrożenia dla prywatności danych, sierpień 2023, https://www.legalfly.ai/blog/data-privacy (ostatni dostęp 24 listopad 2023).